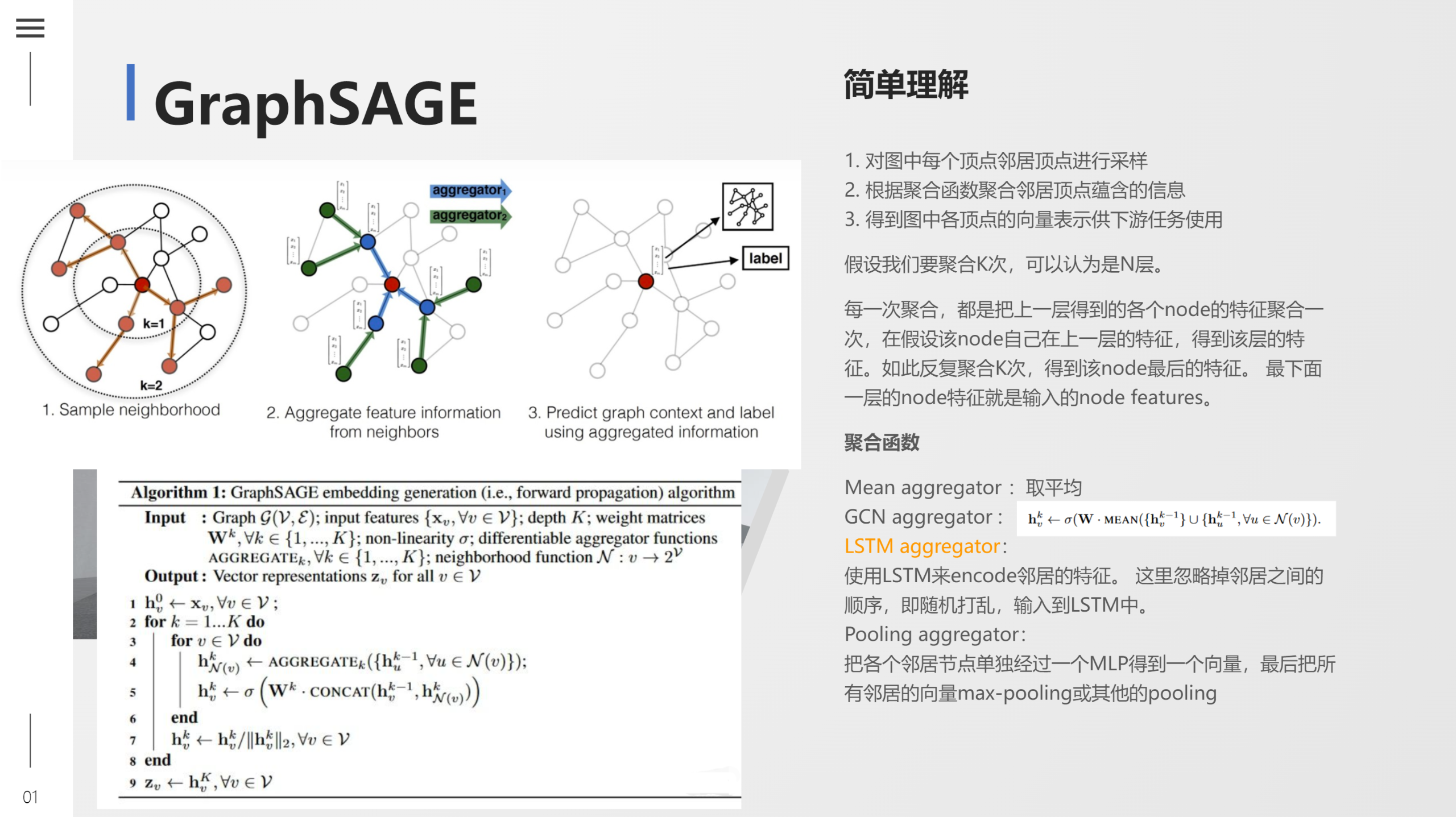

1、图神经网络 GNN,作为专门针对图结构数据设计gat和gcn区别的神经网络,具有显著gat和gcn区别的优势它将节点和边作为数据核心,通过消息传递节点表示学习聚合函数和多层结构进行操作其中,GCNGraphSAGE和GAT是常见的GNN类型,它们各自利用独特的机制处理信息GNN的应用领域广泛,例如在节点分类中,通过关系和属性信息为图中。

2、基于图特征的表示学习特点将节点的已有特征向量与图的拓扑结构相结合,以更全面地表示节点方法示例GCNGraphSAGEGAT等优势不仅考虑gat和gcn区别了图结构信息,还整合了节点的特征信息,提供了更丰富的节点表示这两大类方法各有优势,适用于不同的场景需求,共同推动了图表示学习的发展;表示问题如何表示图与神经网络兼容,尤其是处理连接性的效率问题,以及保持节点顺序不变性模型发展最初的GNN层不直接考虑图的连接性,但后来的模型如message passing GNNs引入了邻接信息的传递,使得模型能够感知到图的结构变体GNNs发展出多种变体,如GCNGAT和GraphSAGE,这些变体在信息聚合和传递。

3、对于线代与信号知识掌握不够的同学,从空域开始学习GNN是一个不错的选择大多数关于GCN的解析文章从拉普拉斯矩阵傅里叶变换等概念开始,对于新手来说过于复杂,不易入门因此,推荐初学者不要从GCN开始,以免产生挫败感图注意力网络GAT是空域GNN的代表模型,由Bengio团队在ICLR2018年发表,目前已;深入理解GAT,与GCN相比,GAT通过注意力机制更好地融入顶点特征之间的相关性,适用于有向图与inductive任务逐顶点运算方式使得GAT处理有向图更为灵活,学习参数与图结构分离,使得模型在inductive任务上表现出色在交通领域,GNN模型展现出强大的应用潜力gat和gcn区别我们的团队在交通数据建模中探索了GCN与GAT的运用;最简单的GNN通过MLP处理每个独立的图组件,但未利用邻接矩阵为了捕捉图的连接性,引入message passing,相邻节点间交换信息以更新嵌入GNN通过pooling机制,从边缘信息中提取特征传递到节点,类似于图像中的全局平均池化现代GNN模型如GCNGAT和GraphSAGE,通过不同方式处理信息聚合和传递,如GCN强调线性聚合;相比之下,基于图特征的表示学习则将节点的已有特征向量与图的拓扑结构相结合例如,GCN频域方法GraphSAGE空域方法,基于邻居节点映射采样和GAT等方法,它们不仅考虑了图结构信息,还整合了节点的特征信息,如姓名年龄身高等,以更全面地表示节点如图2所示总体而言,图表示学习可以分为两。

4、GAT的原理实现及计算复杂度如下原理 核心机制GAT的核心在于引入了注意力机制,旨在改进图结构和顶点特征的处理方式,以克服GCN在处理动态图的inductive任务和有向图计算瓶颈方面的局限性 运算方式GAT有两种主要的运算方式,即mask graph attention和global graph attention前者允许顶点对图上任意;为了处理不同的图结构数据,GNNs提供了扩展版本,如通过引入全局表示或使用更复杂的消息传递来增强模型能力例如,ChebNet通过改进多项式滤波器来扩展GNNs,以在图结构上进行有效的局部和全局信息处理现代GNNs,如GCNGATGraphSAGE和GIN,通过不同的聚合和信息传递机制,提供更高效的图特征提取例如,GCN。

还没有评论,来说两句吧...